Nois(e) Canceling?

이번 리서치는 인터랙티브 미디어아트 《No Is Canceling》의 제작 과정과 그에 수반된 기술적 실험, 해석, 그리고 비판적 인식을 정리한 기록입니다. 기술 자체의 시각적 작동 원리를 파헤치며 그것이 작동하지 않는 틈, 흔들리는 픽셀의 여백, 인식되지 않은 데이터의 주변부를 해석하고, 그로부터 새로운 현실을 상상하려는 시도입니다. 리서치는 이미지 세분화 모델, 디지털 지도, 스트리트뷰, 딥러닝 기반 생성 모델 등이 작품에서 어떻게 연결되어 있는지 함께 서술합니다.

This research documents the production process, accompanying technical experiments, interpretations, and critical insights of the interactive media art work, 《No Is Canceling》. It is an attempt to interpret the gaps where technology fails to operate, the margins of oscillating pixels, and the periphery of unrecognized data by deconstructing the visual operating principles of technology itself, and from these points, imagine a new reality. The research also describes how Image Segmentation models, digital maps, Street View, and deep learning-based generative models are connected within the work.

Section 1 – 작업의 배경

현대 기술은 점점 더 매끄럽고 투명한 환경을 지향하며, 보이지 않을수록 자연스럽다고 여겨진다. 블랙박스 모델이나 반도체의 미시 세계처럼, 기술은 우리의 시야 밖에서 조용히 작동하고, 그 결과로 생성된 이미지는 아무것도 감추지 않은 듯한 표면을 구성한다. 그러나 이 매끄러운 이미지의 이면에는, 무엇을 볼 것인가를 끊임없이 선택하고 구분하는 작동이 있다. 인공지능 이미지 세분화(Segmentation) 기술은 대상을 경계짓고 명명함으로써 세계를 분할하고, 그 위에 의미를 부여한다. 경계가 명확할수록, 더 많은 자본 및 권력과 연결될 가능성이 높을수록, 데이터는 이미지 위에서 독자적인 명칭을 부여받고 강화된다. 반면, 해상도가 낮거나 일시적인 존재들, 라벨링되지 못한 픽셀들—분류되지 않는 노이즈들—은 제거의 대상으로 간주된다.

이 작업은 기술의 시야에서 벗어난 노이즈를 단순한 오류가 아니라, 세계로부터 밀려난 존재들의 잔재이자 또 다른 서사의 단초로 바라본다. AI 기반 이미지 세분화(Segment Anything) 모델을 활용해 기술 이미지 속 분류되지 못한 잔재들을 수집하고, 이를 CRT 디스플레이 속 ‘Mx.NO’라는 존재로 재구성해 그의 서사를 추적하고 상상해나간다. 지워진 신체, 흐릿한 경계, 자투리처럼 남은 픽셀들은 기술적 사실성과 정치적 배제가 교차하는 지점을 드러내며, 또 다른 방식의 세계를 만든다.

작품은 단순히 AI의 픽셀 분류 기술을 비판적으로 바라보는 작업이 아니라, 지난 2년간 이어진 작가의 디지털 지도 리서치 과정에서 출발했다. 작품 Escape Maps(2022)에서 우리는 구글 스트리트뷰와 같은 디지털 지도 시스템이 현실을 어떤 방식으로 재현하고 구성하는지, 그리고 그 과정에서 무엇이 선택되고, 무엇이 배제되는지를 추적해왔다.

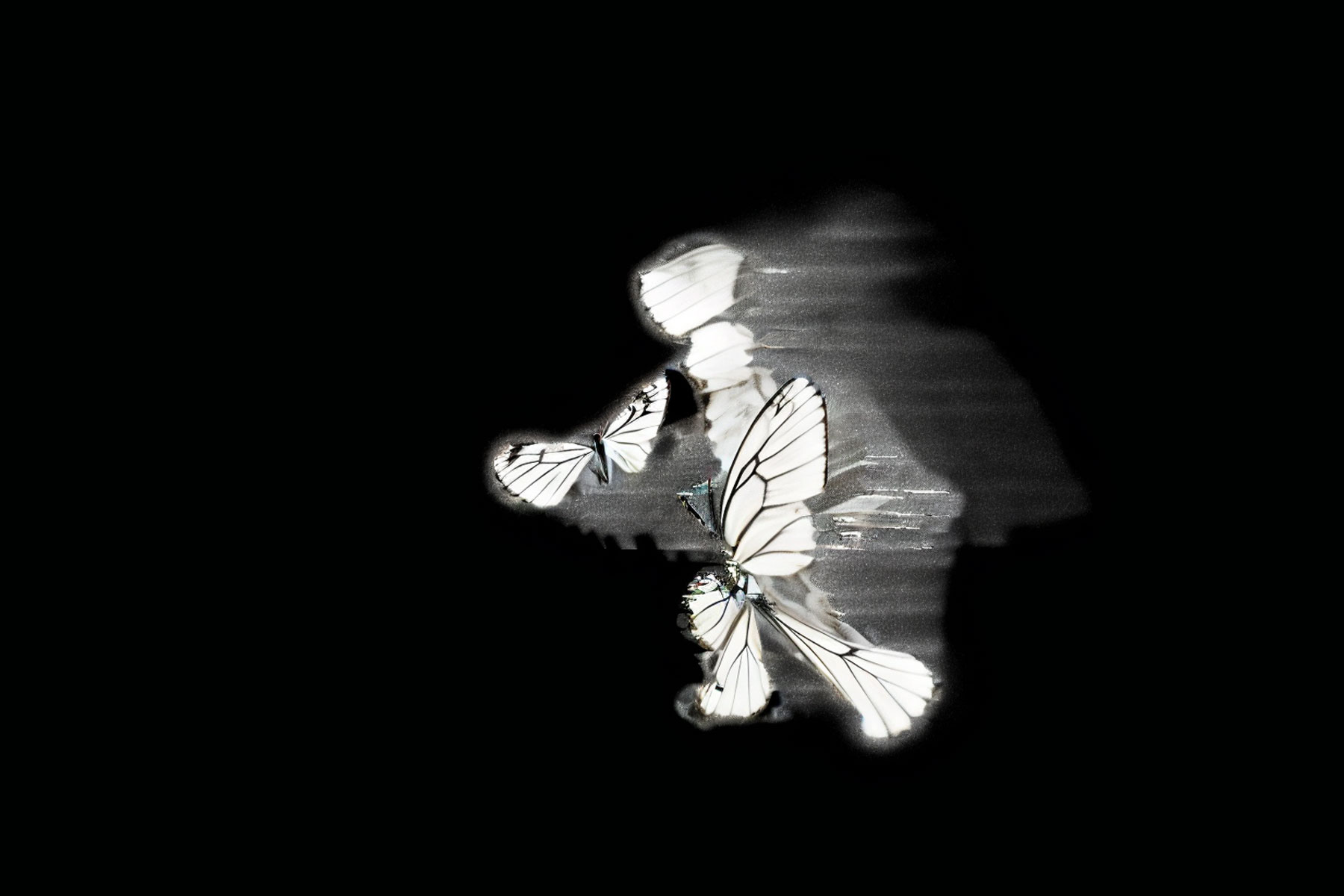

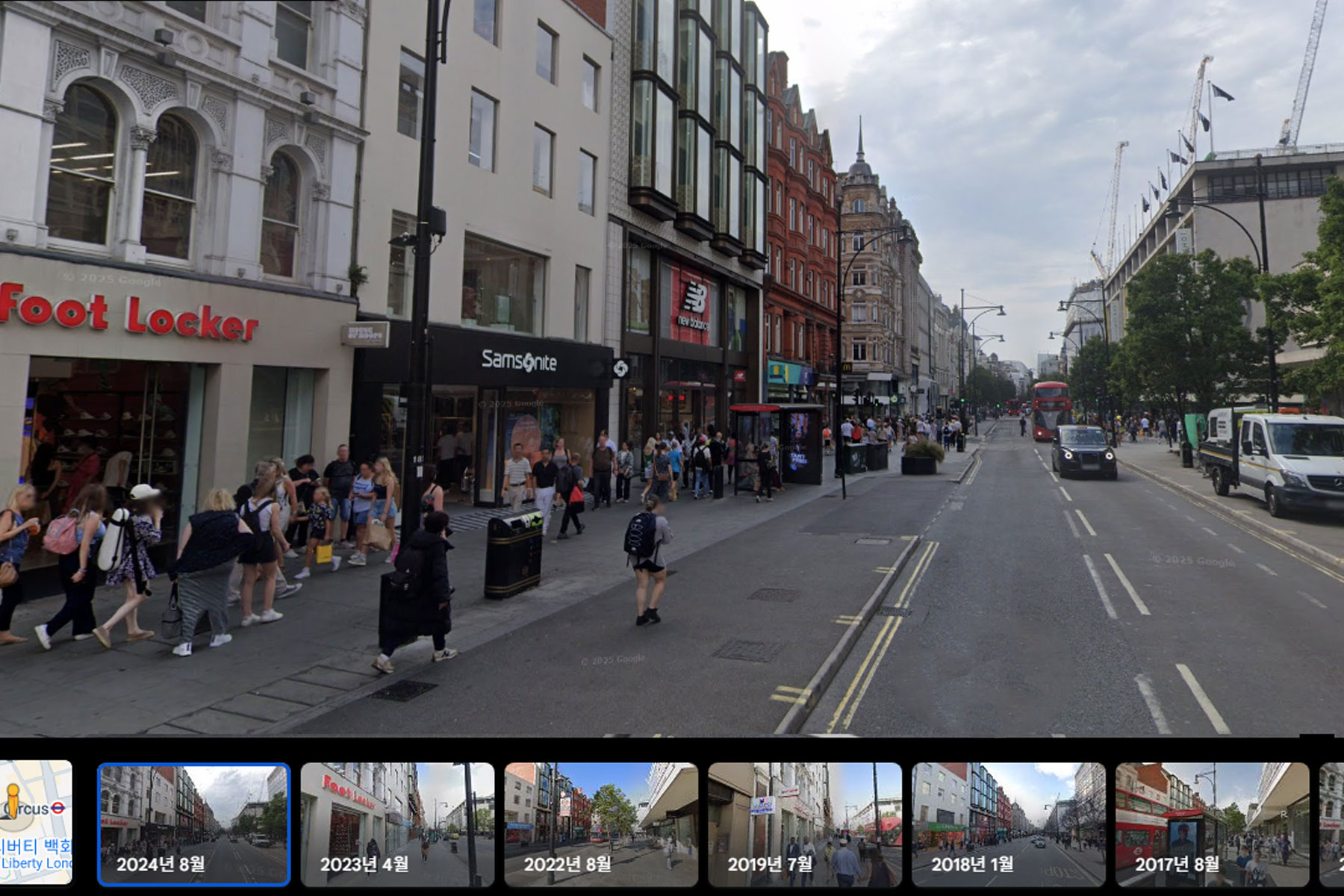

우리가 주목한 것은, 스트리트뷰를 비롯한 지도 시스템이 정적(static)이고 식별 가능한 데이터를 우선적으로 지도에 매핑한다는 점이다. 기술은 이동하거나 일시적인 것, 흐릿하고 어두운 장면에는 반응하지 않으며, 이는 곧 기술이 선호하는 시각성의 구조를 드러낸다. 특히 밤의 스트리트뷰, 즉 어둡고 식별 가능한 정보가 적은 이미지들은 종종 삭제되거나, 더 밝고 고화질의 장면들로 대체되고 있었다. 이 현상은 단지 시각적 선호의 문제가 아니라, 스트리트뷰 이미지가 자율주행차, AI 훈련 데이터, 지도 서비스 등 자본과 기술 권력이 작동하는 구조의 일부로 수집되고 선택된다는 사실과 연결된다.

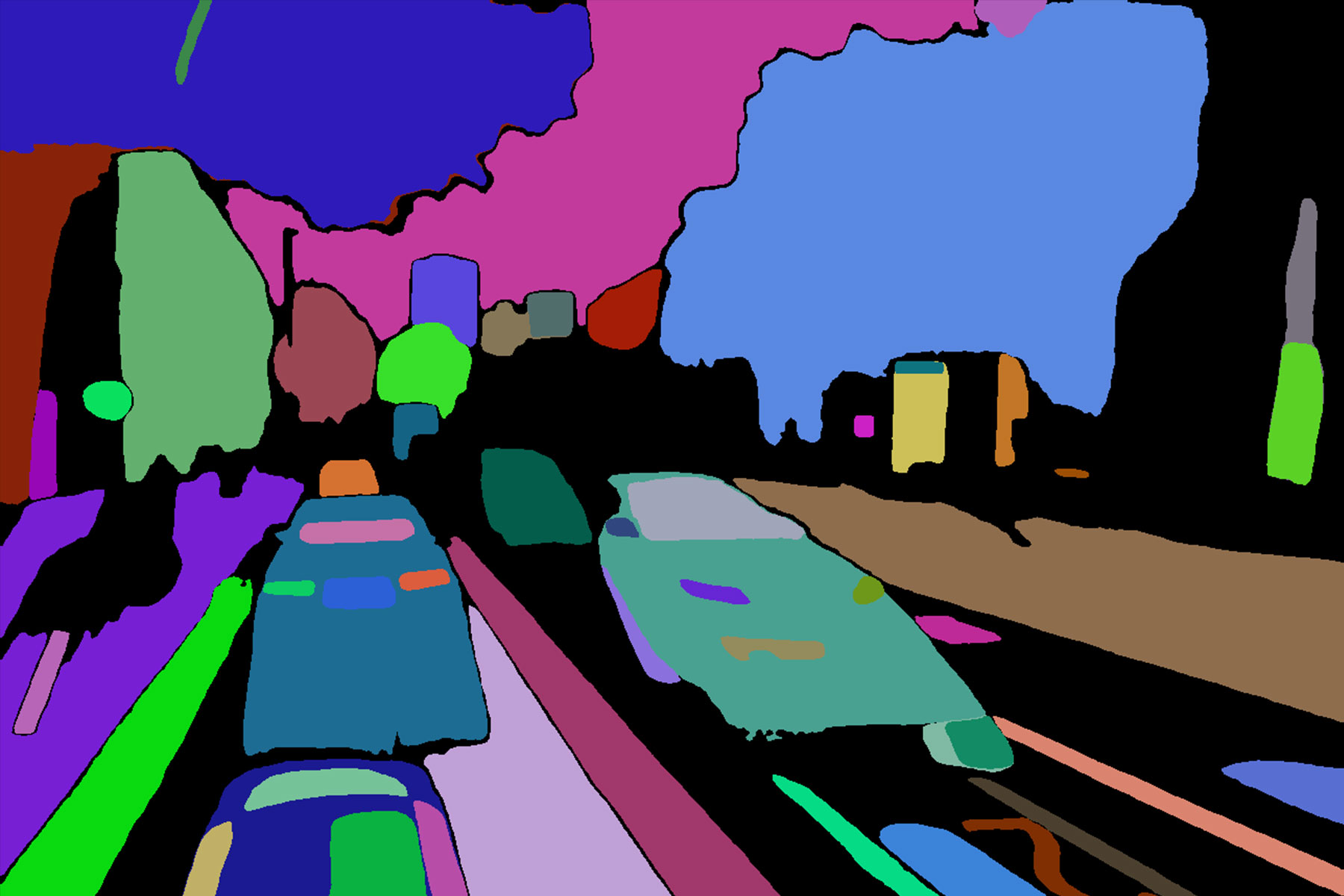

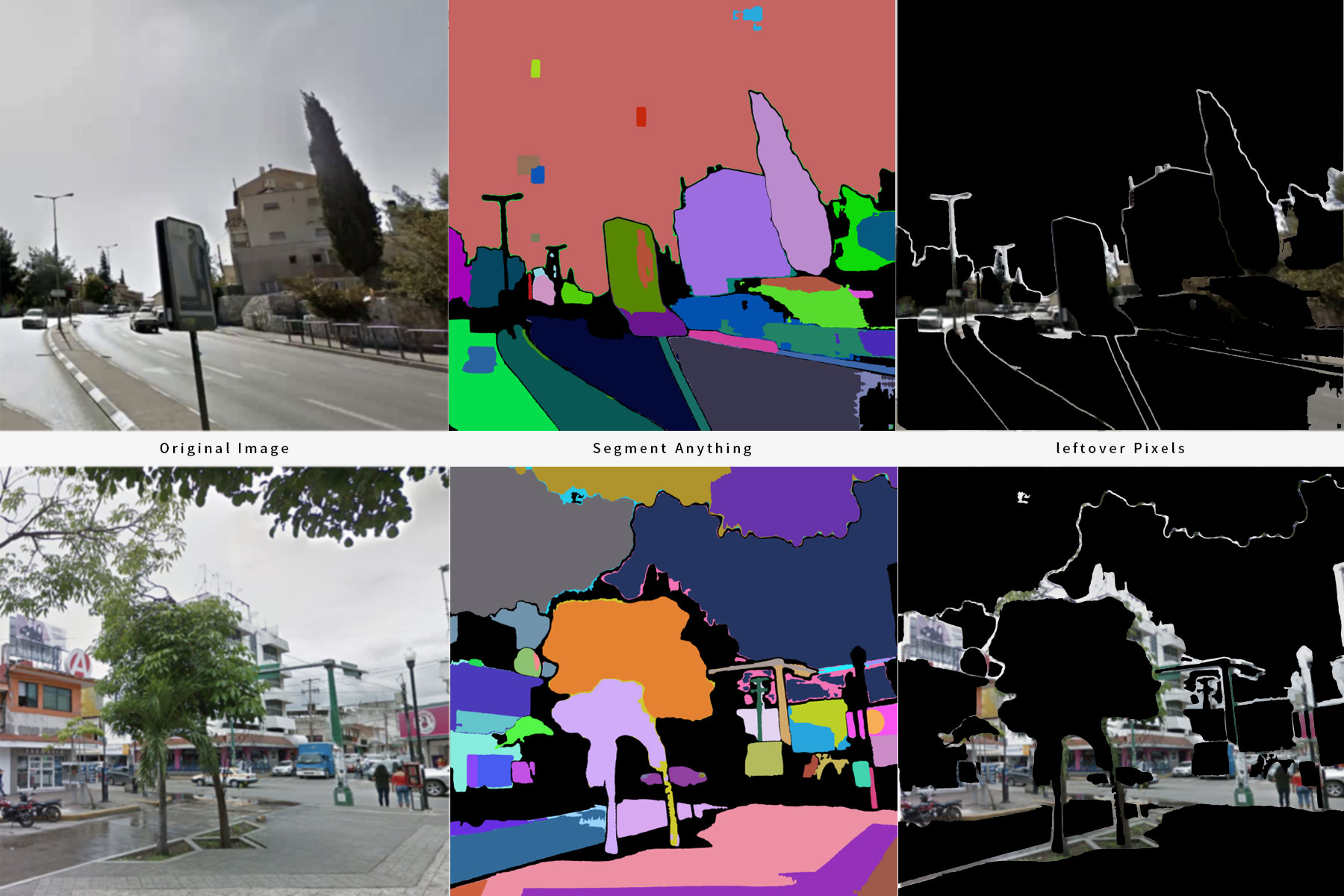

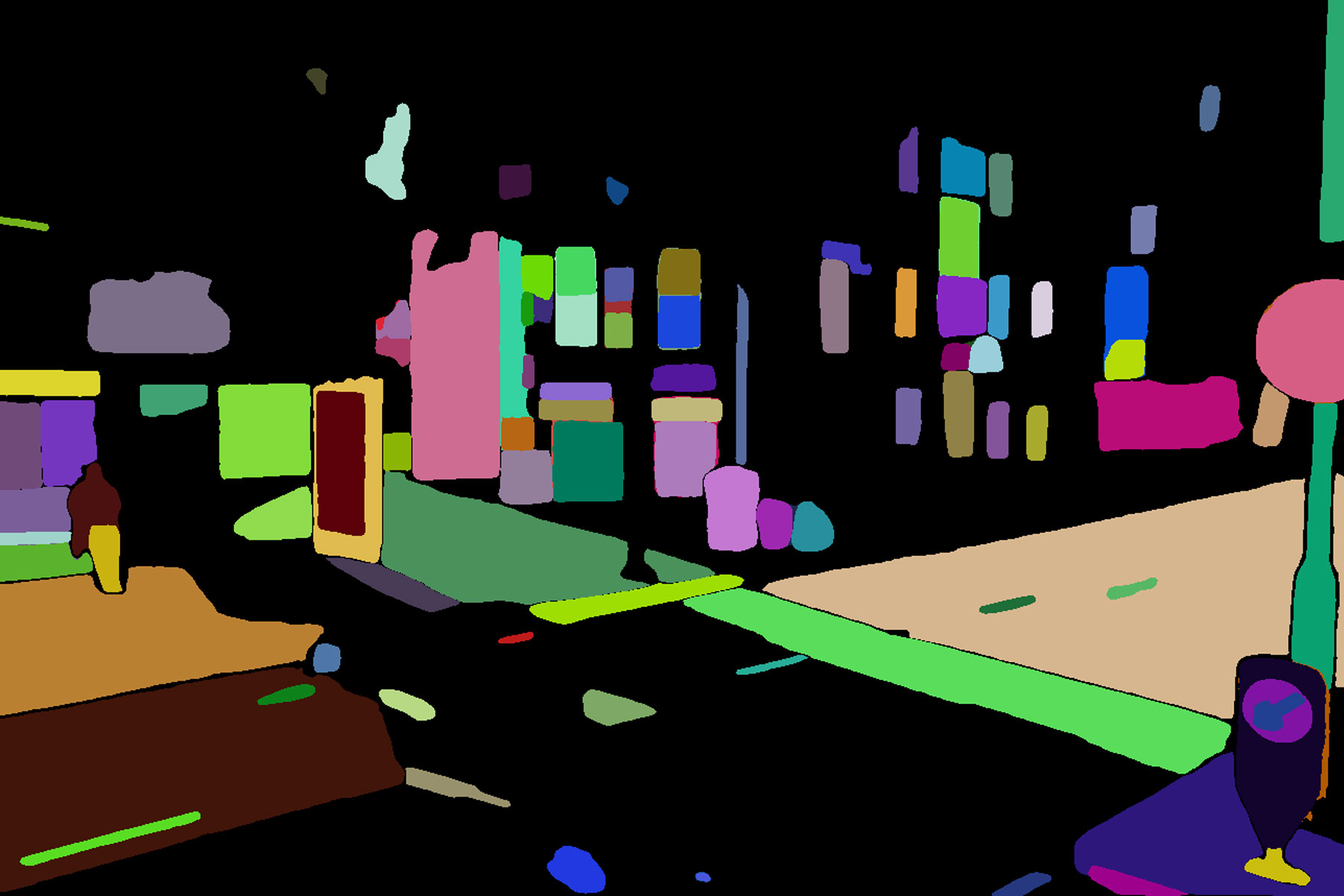

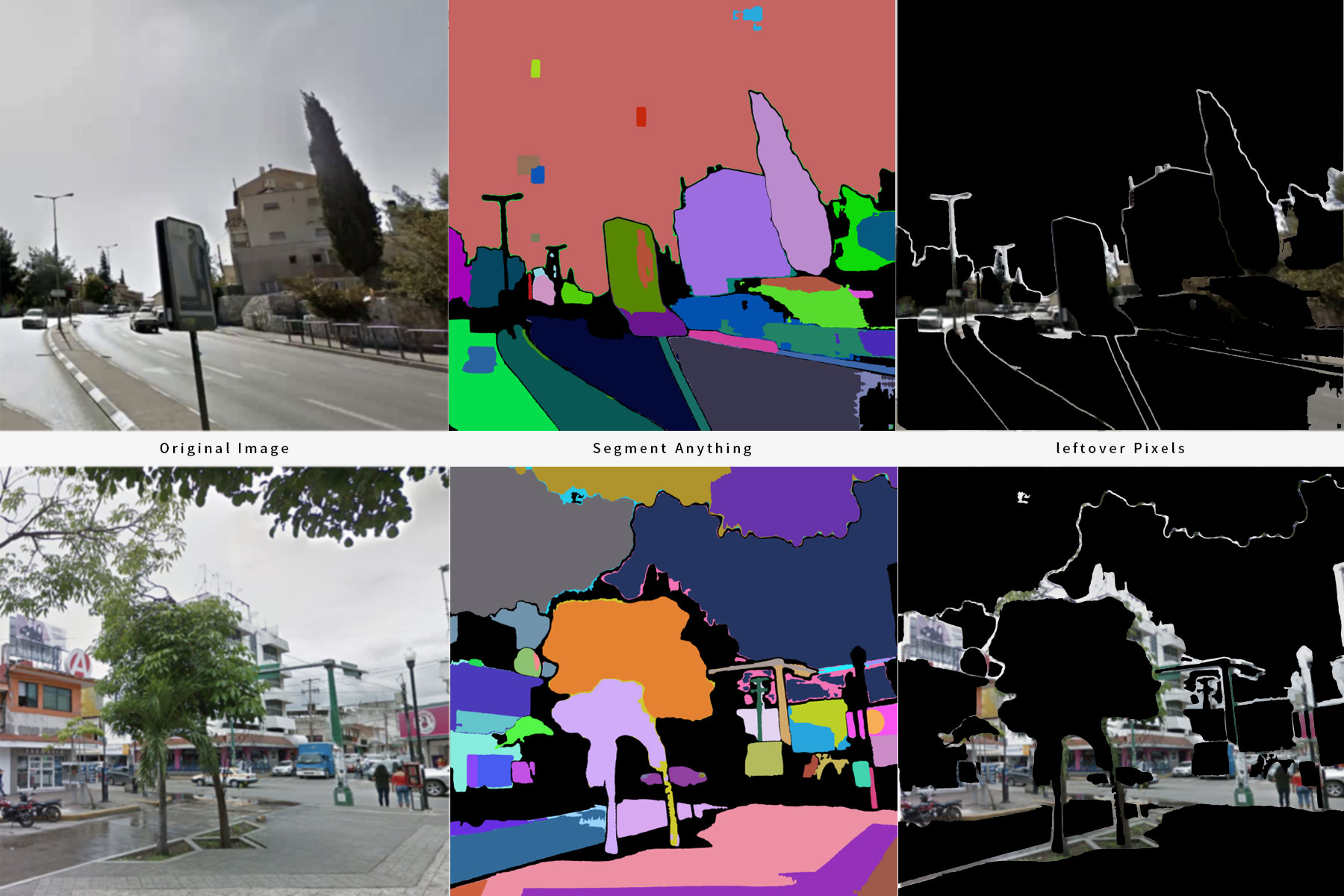

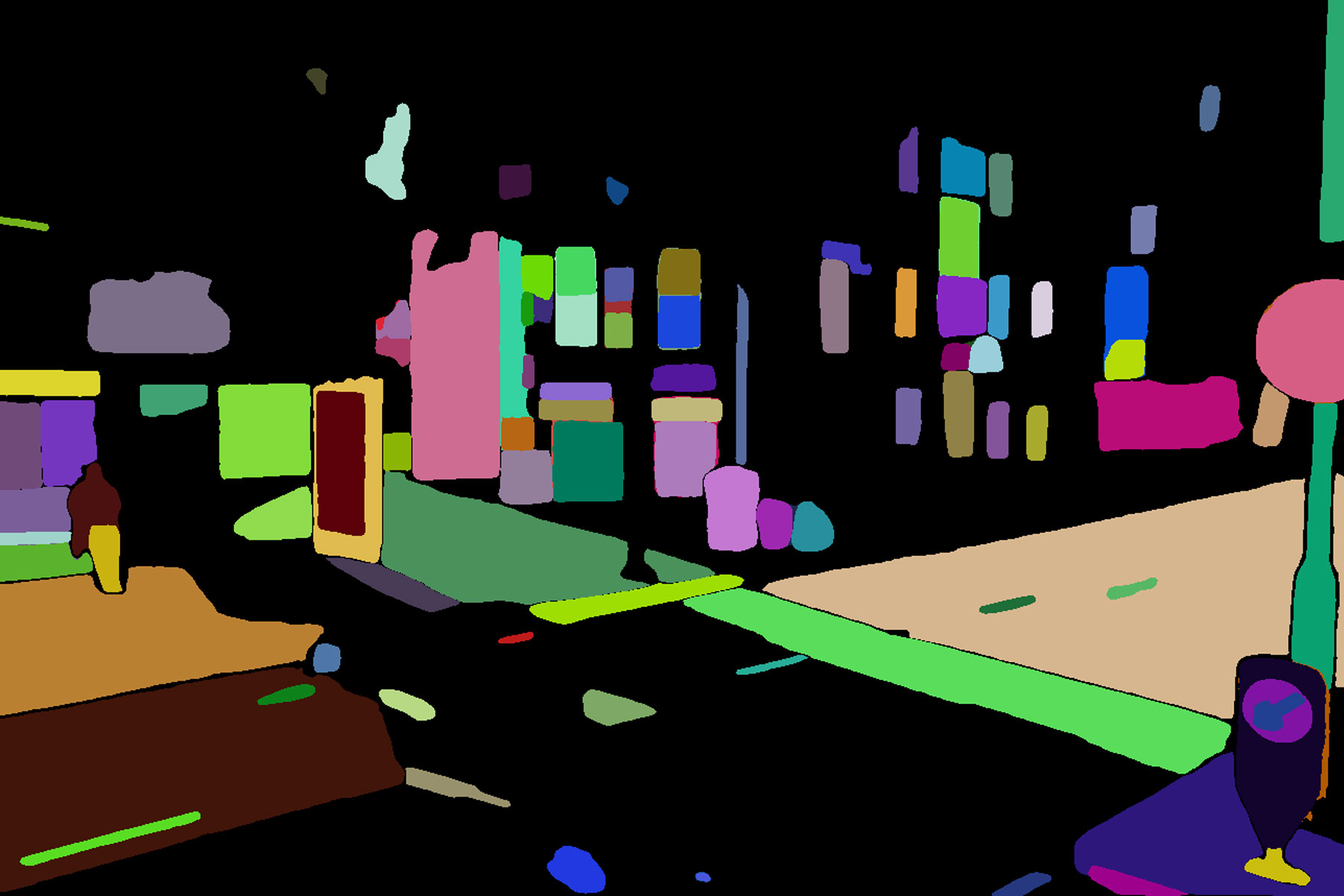

이러한 문제의식 아래, 우리는 ‘스트리트뷰 이미지에서 AI는 무엇을 보고 있는가?’라는 질문을 품고, Meta AI의 Segment Anything 모델(SAM)을 스트리트뷰 데이터에 적용하기 시작했다. 이 실험은 단순한 기술 테스트가 아니라, 기술이 보는 시선—무엇을 분할하고, 어디까지를 객체로 인식하며, 무엇을 남기고 무엇을 삭제하는가—를 역으로 추적하는 과정이었다. 스트리트뷰 이미지 속에서는 다양한 객체들이 분할되지만, AI가 놓치는 픽셀들, 즉 라벨링되지 못한, 검은 공간들이 명확하게 드러났다. 이 '흔적'은 기술이 감지하지 못하는 세계의 모습이자, 그 경계 바깥에 존재하는 분류되지 않는 존재들의 자리였다.

Section 1-1 – 기술이 남긴 픽셀로부터

Mx.NO의 서사 구성

종종 우리는 흐리고 흔들리는 이미지 속에서 예상치 못한 장면을 발견한다. 나부끼는 비닐봉지를 춤추는 까마귀로 착각하고 신기해하고, 버스에 탄 할머니의 하얀 뽀글머리를 혼자 버스에 앉아있는 강아지로 착각해 마음 속 깊이 대견해한다. 그렇게 우리는 이미지의 결함 속에서 다른 이야기를 상상하고, 감각의 균열 속에서 새로운 현실을 엿본다. 이런 경험 속에서 우리는 기술이 남긴 자투리 픽셀들을 단순한 결함이나 오류가 아닌, 다른 세계로 향하는 통로로 바라보게 되었다. 이 자투리 픽셀들은 ‘Mx.NO’라는 존재로 재구성되며, 기술이 식별하지 못한 픽셀, 경계 너머의 잔재들이 각 CRT 채널에서 다양한 서사를 만들어가는 핵심 장치가 된다.

Section 1-2 - 채널 안내

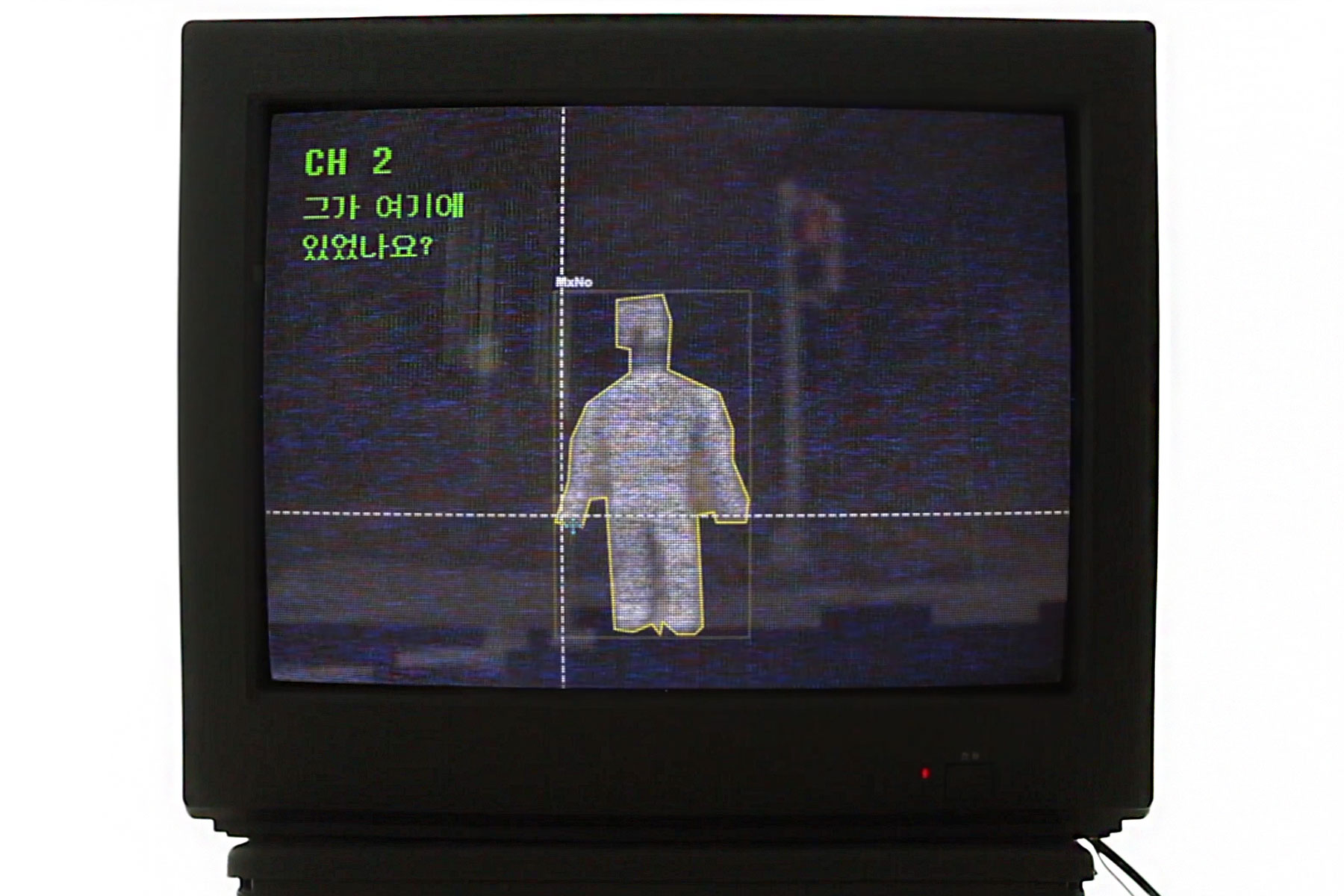

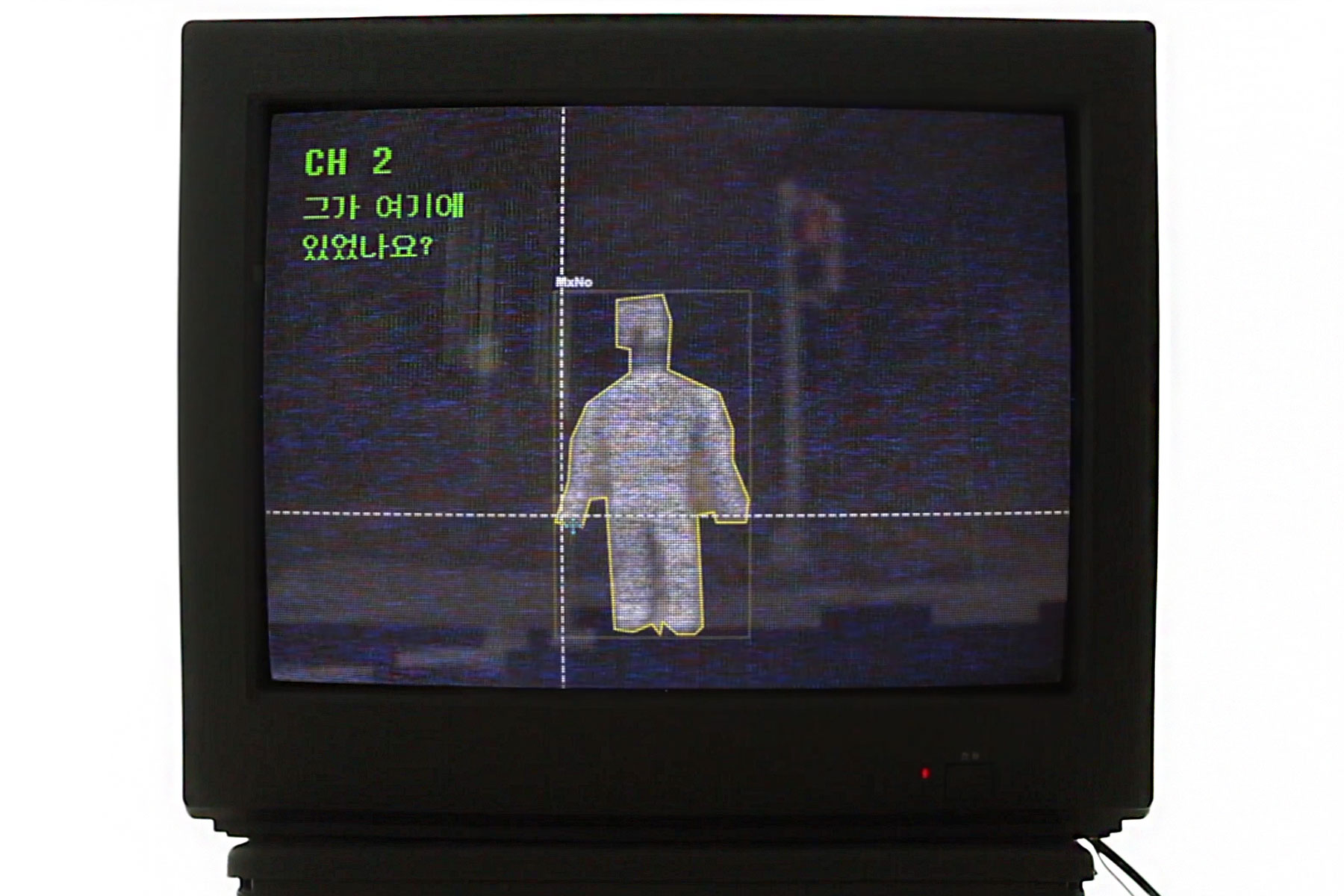

총 9개의 CRT 채널들은 세분화 되지 못한 존재들의 의미를 각기 다른 방식으로 풀어낸다. 채널 1에서는 마치 실종자를 찾는 전단처럼 Mx.NO의 흔적을 탐색하며, 삭제된 관객의 이미지 데이터를 실시간으로 Mx.NO의 표면에 맵핑하며 노이즈를 서사의 중심으로 가져온다. 채널 2는 세분화와 라벨링을 통해 세계를 나누는 기술의 작동 방식을 시각 에세이 형식으로 재구성하여 Mx.NO의 행방을 유추한다. 채널 3, 4, 5는 인식되지 못하고 남은 자투리 픽셀의 모습을 보여주며, 채널 6에서는 기술의 명령에 응답하지 못한 채, 세계에 고정되지 않고 화면 밖으로 계속해서 미끄러지는 Mx.NO가 등장한다. 채널 7은 노이즈 속에 Mx.NO의 모습이 숨겨져있으며, 매직아이처럼 초점을 벗어난 상태에서만 허공에서 허우적대는 그를 발견할 수 있다. 채널 8에서는 실시간 네비게이팅 알고리즘을 따라 Mx.NO가 기술이 남긴 잔여 픽셀 위를 맴돌며 계속해서 새로운 경로를 생성하고 자기 서사를 확장한다. 마지막 채널 9는 생성형 디퓨전 모델을 통해 노이즈를 환영적 이미지로 되살리며, 낮은 신뢰도로부터 생성된 이미지의 떨림과 흐릿함 속에서, 사라진 존재들을 유령처럼 다시 등장시킨다.

Section 1-3 - CRT TV

서사를 담아내는 매체로서 CRT TV의 물리적 원리 또한 작업의 중요한 축을 이룬다. CRT는 전자총에서 방출된 전자빔이 화면을 구성하는 형광체에 물리적으로 충돌해 빛을 내고, 그로써 이미지가 맺히는 방식으로 작동한다. 이는 오늘날의 평면 디지털 디스플레이가 추구하는 매끄럽고 비물질적인 이미지 생성 방식과는 뚜렷하게 대비된다. 우리는 이 ‘충돌’의 흔적이 남는 화면 구조 속에서, 기술 이미지의 삭제와 노이즈, 잔재의 감각을 더욱 직관적으로 전달할 수 있다고 보았다.

CRT는 단지 기술적 장치가 아니라, 이미지에 대한 신뢰의 시대를 상기시키는 매체이기도 하다. 우리는 CRT TV를 바라보며 그것이 ‘거짓일 수 있다’는 의심보다는, 지금 눈앞에 있다는 감각에 가까운 신뢰를 느끼곤 했다. 그렇기에 이 화면 위에 떠오르는 Mx.NO의 형상은, 비록 기술이 삭제하고 잊으려 한 픽셀과 흔적으로부터 재구성된 존재일지라도, 어딘가에 여전히 존재하고 있을지 모른다는 믿음을 조용히 환기시키고자 했다. 단순한 환상이 아니라, 기술적 시야 밖으로 밀려난 존재들에 대한 지속적인 감각, 지워지지 않는 잔재로서의 실재성을 상상하는 방식이다.

Section 2 – 기술 개요

1. Segment Anything (Meta AI)

Meta에서 개발한 범용 세분화(Segmentation) 모델로, 어떤 이미지든 클릭이나 포인터 지점 하나만으로 객체의 경계를 실시간으로 추출할 수 있다. 이 기술은 ‘무엇을 볼 것인가’를 선택하고 구분하는 기술 이미지의 시선을 상징한다. 작품에서는 기술이 어떻게 세계를 ‘인식’하고 명명하는지, 그리고 그 과정에서 남겨지는 경계의 흐릿함과 노이즈를 시각화하기 위해 사용되었다. 그러나 기술은 완벽하지 않기에, 그 과정에서 애매한 경계, 흔들리는 윤곽, 제거되지 못한 노이즈들이 남는다.

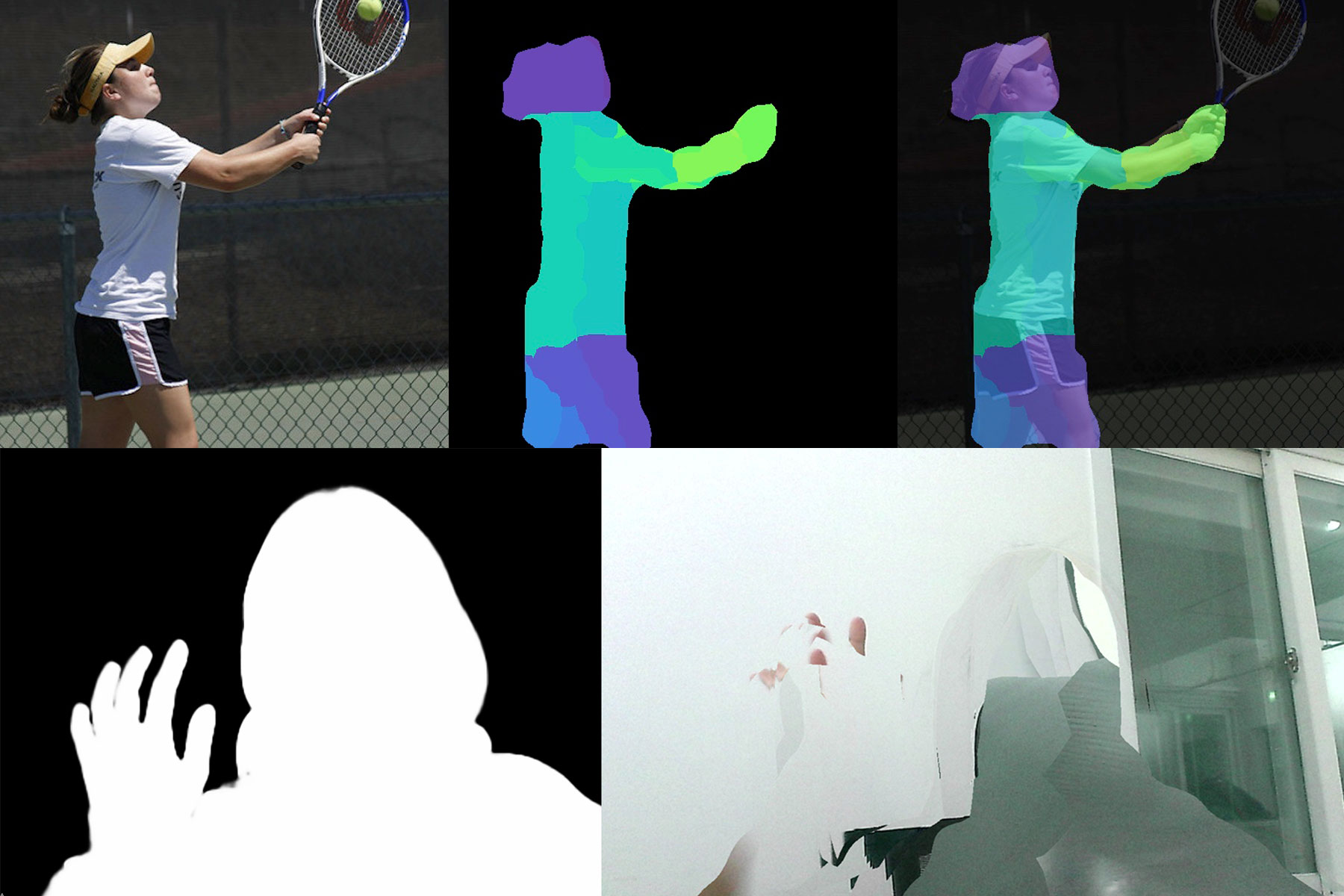

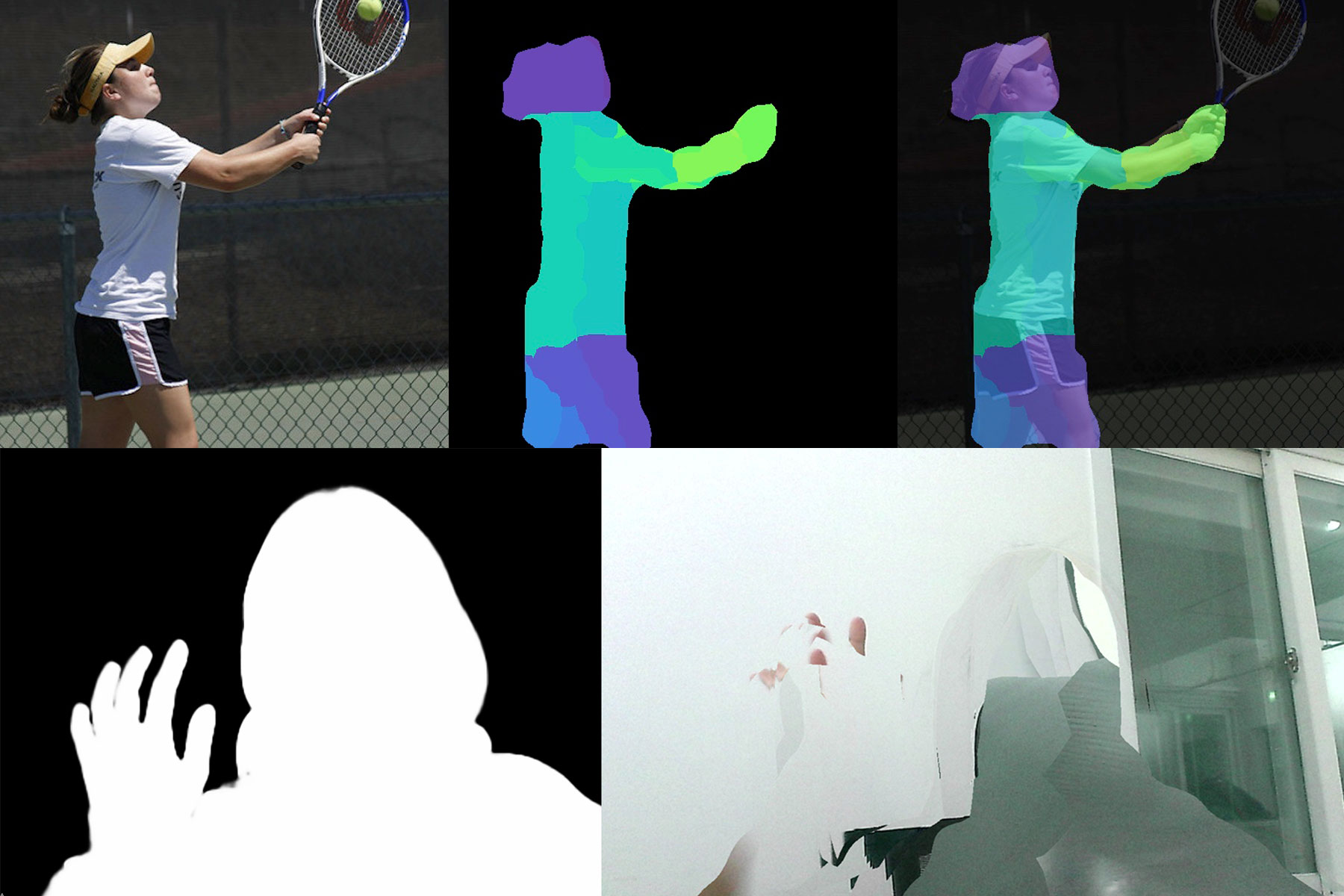

2. BodyPix

BodyPix는 TensorFlow.js 기반으로 개발된 실시간 신체 세분화(Semantic Segmentation) 모델이다. 화면 내 인물의 각 신체 부위—머리, 어깨, 팔, 다리 등—를 픽셀 단위로 분류해 mask로 생성한다. 작품에서는 관객의 신체를 실시간으로 감지하고, 해당 영역을 배경에서 분리 및 제거하는 방식으로 작동한다. 이 때 사용되는 마스크는 이미지의 각 픽셀이 ‘사람인지 아닌지’를 판단하여 생성되며, 이를 통해 영상 속 인물과 배경이 구분된다. 관객의 몸이 감지되면, 그 신체 부위는 영상에서 제거되고, 남겨진 배경 정보만이 화면에 유지된다.

신체가 있던 자리를 배경으로 복원하는 과정은, 저장된 이미지나 예측이 아닌 실시간으로 캡처한 프레임과 시각적 잔상을 활용해, 인물이 있었던 자리를 덮어씌우는 방식으로 구현된다. 이러한 방식은 신체의 삭제가 곧 완전한 사라짐을 의미하지 않음을 드러낸다. 기술이 제거한 자리에는 여전히 흔적이 남고, 지워진 인물의 실루엣은 어렴풋이 화면 위에 떠돈다. 작품은 이처럼 인물의 부재 속에 남겨진 미세한 흔적들을 통해, 기술이 감지하지 못하는 존재와 감각을 되묻는다.

상단 이미지: Person Segmentation with bodypix (출처: https://blog.tensorflow.org/2019/11/updated-bodypix-2)

하단 이미지: 신체가 있던 자리를 배경으로 복원 테스트. 관객의 몸이 감지되면, 그 신체 부위는 영상에서 제거되고, 남겨진 배경 정보만이 화면에 유지된다. 기술이 제거한 자리에는 여전히 흔적이 남고, 지워진 인물의 실루엣은 어렴풋이 화면 위에 떠돈다.

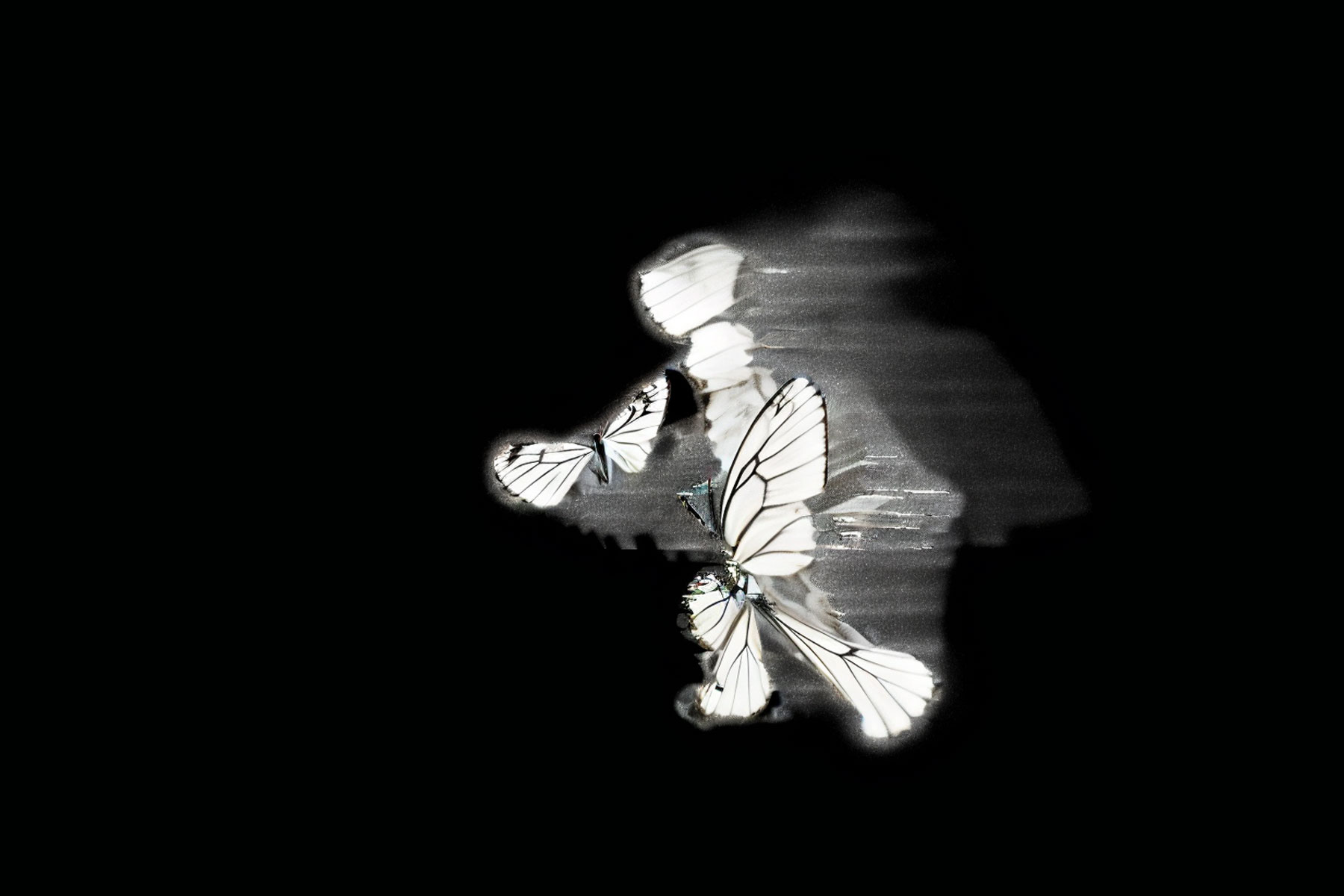

3. Diffusion Model (Stable Diffusion)

노이즈로부터 이미지를 생성하는 생성형 AI 모델. 특정 조건을 부여하거나 낮은 신뢰도에서 작동시킴으로써, 의도적이고 불완전한 이미지 생성이 가능하다. 이 모델은 ‘환영의 춤’ 채널에서 사용되며, 사라진 존재들이 떨리고 흐릿하게 다시 출현하는 장면을 연출한다. 불확실성과 흐릿함 자체가 이미지로 구체화되면서, 기술이 감지하지 못하는 또 다른 세계가 열린다.

No is caceling, CH9 Screen Capture

Section 3 - 흐릿해지기 / 투명해지기

경계에 탑승하는 전략

오늘날 기술은 점점 더 선명하고 구분 가능한 세계를 지향한다. 이미지 세분화 모델이 경계를 강화하고, 명확한 라벨링이 자본과의 연결 가능성을 높인다. 이런 흐름 속에서 ‘알 수 없음’은 종종 배제의 사유가 되고, 흐릿하고 중간적인 존재들은 기술 시스템의 시야에서 지워지거나 무시된다.

이 프로젝트는 이러한 흐름에 대항하기 위해 역설적으로 더 흐릿해지고, 더 투명해지고, 픽셀 단위로 기술 이미지 위에 스며드는 태도를 상상한다. 이는 명확한 대상이 되기를 거부하는 것이 아니라, 지나치게 투명해서 포함될 수 밖에 없는, 그러나 의미를 부여받지 않는 존재로 세계에 머무는 방식이다. 이 흐릿한 실천은 기술이 요구하는 표면성을 모방하면서 그 체계 내부에 잠입하고, 시각성과 감지성의 구조를 교란시키고자 하는 작지만 지속적인 전략이다.

Section 1 – Background of the Work

Contemporary technology increasingly aims for seamless and transparent environments, where invisibility is often equated with naturalness. Like black-box models or the microscopic world of semiconductors, technology silently operates outside our view, and the resulting images construct a surface that appears to conceal nothing. However, beneath this smooth image surface is a continuous operation of selecting and distinguishing what is to be seen. Artificial intelligence Image Segmentation technology divides the world by demarcating and naming objects, thereby imposing meaning upon it. The clearer the boundary, and the greater the potential connection to capital and power, the more the data is assigned a unique name and reinforced on the image. Conversely, low-resolution or transient existences—pixels that fail to be labeled, or unclassified noises—are often considered objects for removal.

This work views the noise that escapes the technical gaze not merely as an error, but as the residue of existences pushed aside from the world and the starting point for alternative narratives. Utilizing the AI-based Image Segmentation model (Segment Anything), the work collects these unclassified remnants from technical images and reconstitutes them into a being named 'Mx.NO' within a CRT display, tracing and imagining its narrative. The erased bodies, blurry boundaries, and leftover pixels reveal a juncture where technical facticity intersects with political exclusion, forging an alternative mode of the world.

The work is not solely a critical examination of AI's pixel classification technology; it originated from the artist's two-year research into digital maps. In the work Escape Maps(2022)we traced how digital map systems like Google Street View represent and construct reality, and in the process, what is selected and what is excluded.

We noted that map systems, including Street View, prioritize mapping data that is static and readily identifiable. Technology fails to react to mobile or transient elements, blurry or dark scenes, thus exposing the structure of visuality that it favors. Specifically, nighttime Street View images—those that are dark and contain little identifiable information—were often being deleted or replaced with brighter, high-definition scenes. This phenomenon is not merely an issue of visual preference; it is connected to the fact that Street View images are collected and selected as part of a structure where capital and technical power operate, such as in autonomous vehicle training, AI datasets, and map services.

[Image Caption] Nighttime Street View from September 2018 is currently unavailable [Link to deleted Night Street View]

Under this critical awareness, we posed the question: 'What is AI seeing in Street View images?' and began applying Meta AI's Segment Anything Model (SAM) to Street View data. This experiment was not a mere technical test but a process of reverse-tracing the technological gaze—what it partitions, how far it recognizes an object, and what it leaves behind versus what it deletes. Within the Street View images, various objects were segmented, but the pixels missed by the AI—the black, unlabeled spaces—were clearly revealed. These 'traces' represented a vision of the world undetectable by technology, the position of unclassified beings existing beyond its boundary.

Section 1-1 – From Pixels Left by Technology

Constructing the Narrative of Mx.NO

We often discover unexpected scenes in blurry and shaky images. We might mistake a fluttering plastic bag for a dancing crow and be momentarily fascinated, or perceive a grandmother’s white permed hair on a bus as a dog sitting alone, feeling a deep, internal pride. In such experiences, we imagine alternative stories within the image's imperfections and glimpse new realities through cracks in perception. It is in these moments that we came to view the leftover pixels abandoned by technology not as mere defects or errors, but as pathways to another world. These leftover pixels are reconstituted into a being named 'Mx.NO,' becoming the core mechanism through which the technology's unidentified pixels and remnants beyond the boundary create diverse narratives across nine CRT channel

Section 1-2 - Channel Guide

The total of nine CRT channels explore the meaning of unsegmented existences in distinct ways. Channel 1 tracks Mx.NO's traces, much like a missing person flyer, mapping real-time, deleted audience image data onto Mx.NO's surface, thus bringing the noise to the center of the narrative. Channel 2 reconstructs the technological mechanism of dividing the world through segmentation and labeling into a visual essay format, inferring Mx.NO's whereabouts. Channels 3, 4, and 5 show the form of the leftover pixels that failed to be recognized. Channel 6 features Mx.NO, who fails to respond to technological commands, continuously slipping off-screen without being fixed into the world. Channel 7 hides Mx.NO's figure within the noise, discoverable only in the out-of-focus state, much like a magic eye puzzle, where the figure is seen floundering in the void. In Channel 8, following a real-time navigating algorithm, Mx.NO circles above the residual pixels left by technology, continuously generating new paths and expanding their self-narrative. Finally, Channel 9 resurrects the noise into a phantasmagoric image through a generative Diffusion Model, where the lost beings are made to reappear like ghosts amid the trembling and blurriness of images generated from low confidence levels.

Section 1-3 - CRT TV

The physical principle of the CRT TV as the medium carrying the narrative also forms an important axis of the work. The CRT operates by having electron beams, emitted from an electron gun, physically collide with the fluorescent screen to emit light, thereby forming an image. This contrasts sharply with the seamless, non-material image generation method pursued by today's flat-panel digital displays. We believe that this screen structure, which retains the trace of 'collision,' more intuitively conveys the sensation of technical image deletion, noise, and residue.

The CRT is not merely a technical device but also a medium that recalls an era of trust in the image. When looking at a CRT TV, we tended to feel a sense of trust—close to the sense of being present—rather than a suspicion that it 'could be false.' Therefore, the figure of Mx.NO emerging on this screen, even though it is reconstructed from pixels and traces that technology attempted to delete and forget, quietly seeks to evoke a belief that they might still exist somewhere. This is a way of imagining reality not as a mere illusion, but as a persistent sense of existences pushed outside the technical gaze—as an indelible residue.

Section 2 – Technical Overview

1. Segment Anything (Meta AI)

A general-purpose Segmentation model developed by Meta, capable of extracting object boundaries in real-time with just a click or a single pointer location on any image. This technology symbolizes the technical gaze that selects and distinguishes 'what is to be seen.' In the work, it is used to visualize how technology 'perceives' and names the world, and the resulting blurriness and noise of the boundaries left behind in the process. However, because technology is imperfect, ambiguous boundaries, oscillating contours, and undeleted noises remain.

2. BodyPix

BodyPix is a real-time body Semantic Segmentation model developed on TensorFlow.js. It classifies and creates a mask for each body part of a person in the frame—head, shoulders, arms, legs, etc.—at the pixel level. In the work, it functions by detecting the audience's body in real-time, separating and removing that region from the background. The mask used in this process determines whether each pixel of the image 'is or is not a person.' When the audience's body is detected, that body part is removed from the video, and only the remaining background information is preserved on the screen.

The process of restoring the area where the body was with the background is realized by utilizing visual afterimages and frames captured in real-time, rather than stored images or predictions, to overwrite the space where the person stood. This method reveals that the deletion of a body does not signify complete disappearance. Traces still remain in the place that technology removed, and the silhouette of the erased person vaguely lingers on the screen. The work uses these subtle traces remaining amidst the absence of the person to question existences and sensations undetectable by technology.

상단 이미지: Person Segmentation with bodypix (출처: https://blog.tensorflow.org/2019/11/updated-bodypix-2)

[Image Caption] Lower Image: Test of restoring the background where the body was. When the audience's body is detected, that part is removed from the video, and the remaining background information is preserved on the screen. Traces still remain in the place that technology removed, and the silhouette of the erased person vaguely lingers on the screen.

3. Diffusion Model (Stable Diffusion)

A generative AI model that creates images from noise. By providing specific conditions or operating it at a low confidence level, intentional and incomplete image generation is possible. This model is used in the 'Dance of Phantoms' channel, where the deleted existences reappear, trembling and blurry. As uncertainty and blurriness themselves materialize into images, another world undetectable by technology opens up.

No is caceling, CH9 Screen Capture

Section 3 - Becoming Blurry / Becoming Transparent

A Strategy for Boarding the Boundary

Today, technology increasingly aims for a clear and distinguishable world. Image Segmentation models reinforce boundaries, and clear labeling enhances the potential connection to capital. In this trend, 'unknowability' often becomes a reason for exclusion, and blurry, intermediary existences are erased or ignored from the technical system's view.

This project, in opposition to this trend, paradoxically imagines an attitude of becoming blurrier, becoming more transparent, and infiltrating the technical image at the pixel level. This is not a refusal to be a clear object, but a way of staying in the world as an existence that is too transparent to be excluded, yet without being assigned meaning. This blurry practice is a small yet persistent strategy that seeks to imitate the superficiality demanded by technology to infiltrate its system and disrupt the structure of visuality and detectability.